La idea es tan antigua como el propio automóvil, y no por conocida resulta menos excitante: disponer de un vehículo capaz de ver, sentir y adaptarse por sí mismo a las circunstancias de la carretera. Mucho más que un simple piloto automático; verdadera inteligencia artificial capaz de liberar al ser humano de sus errores al volante… Un sueño que todavía parece irrealizable, al menos a corto plazo, y más después del accidente que ayer costó la vida a una viandante en Arizona (EE UU), atropellada por un coche autónomo operado por Uber.

Los principales fabricantes de automóviles y las grandes compañías tecnológicas investigan desde hace años en este terreno, con avances técnicos admirables que, sobre el papel, dan la impresión de ser perfectos. Los sistemas de guiado autónomo ven el entorno, procesan toda la información, la interpretan y dan la orden correspondiente al coche para que actúe en consecuencia.

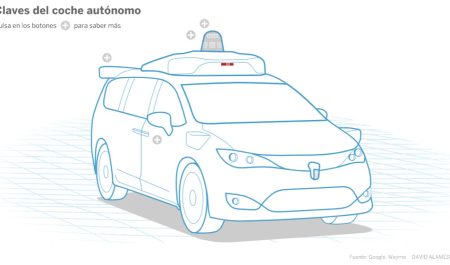

Para desempeñar todas estas labores, los prototipos actuales cuentan con un avanzado equipo formado por cámaras de video estéreo (entre 10 y 12), láseres-escáner y radares que forman un auténtico escudo alrededor del vehículo creando diferentes capas de seguridad que se complementan entre sí para cubrir cualquier error de alguno de los dispositivos. Así, las cámaras recogen las imágenes en 360º alrededor del coche, incluidas señales, semáforos, líneas del piso, etc., y los escáneres detectan objetos, animales y personas en distancias cortas y medias dándoles forma para poder identificarlos.

Los radares miran a más larga distancia para detectar objetos más lejanos y terminar de pintar el cuadro completo. Además, el GPS y la cartografía del navegador sitúan al vehículo en su entorno. Toda esa información se envía a un procesador que la interpreta y da las órdenes en milésimas de segundo a los elementos mecánicos para que tomen la decisión más apropiada.

Así funciona el sistema ProPilot de Nissan, y de un modo muy similar lo hace Waymo, el coche autónomo de Google, que cuenta con 24 sensores de inercia y giro y cuatro emisores/receptores de radar que recogen información constantemente. Un sistema informático se ocupa solamente de la gestión de dirección, frenado y aceleración del automóvil y otro de las restantes variables, siendo capaces de asumir cada uno las funciones del otro en caso de fallo de uno de ellos.

Pero ahí no terminan sus capacidades, ya que el sistema puede incluso detectar condiciones meteorológicas extremas y negarse a circular si intuye peligro potencial o percibe degradación del pavimento. Puede adaptarse sobre la marcha a una carretera con señalizaciones provisionales o con servicios de emergencia trabajando.

Tampoco posibilita tomar atajos y se detiene inmediatamente si se pretende circular por calles y carreteras no registradas en los mapas. Y como el factor humano es siempre el más impredecible, adivina conductas imprudentes de los ocupantes –como no llevar abrochado el cinturón de seguridad, abrir las puertas en marcha o sacar el cuerpo por la ventana– y detiene inmediatamente el vehículo en ese caso.

Sin embargo, el atropello de ayer se produjo precisamente tras una conducta impredecible de la mujer arrollada, que cruzó la calle fuera del paso de peatones. En ese momento, pudo ocurrir que los sistemas fallaran y no la detectaran correctamente, o que (aun viéndola) no supieran convertir la información recibida en una acción apropiada. De cualquier modo, el suceso pone en duda la capacidad de los vehículos autónomos de tomar decisiones que se salgan de la norma. “La inteligencia artificial recoge cientos de miles de datos a gran velocidad, pero todavía no sabe transformarlos siempre en reglas de actuación real», asegura el director de la Unidad de Sistemas Inteligentes en Vehículos del Instituto Universitario de Investigación del Automóvil (INSIA), Felipe Jiménez.

«La conducción automática no es todavía una conducción natural. Siempre pongo un ejemplo: en una rotonda con tráfico muy denso, un conductor experimentado aprovecha el momento adecuado para meter el morro; un coche autónomo se colapsa porque no sabe cómo actuar”.

La convivencia entre vehículos manejados por humanos y coches automáticos es una de las trabas principales para el desarrollo de esta tecnología, y se refleja en la incipiente normativa. Los legisladores estadounidenses y europeos ya han dejado claro que de momento no homologarán un vehículos en los que sus ocupantes no puedan tomar el mando en caso de necesidad.

De hecho, el 5 de octubre de 2017 el Congreso de EE UU aprobó la ley que regulará el uso futuro de estos vehículos. El punto principal de la norma exige y reitera la presencia en todo momento de un ser humano capaz de interactuar, y por tanto destierra la posibilidad de la circulación absolutamente autónoma. Decisiones como esta y accidentes como el de ayer no detienen la investigación, pero alejan un futuro únicamente artificial.

Recibe quincenalmente lo mejor de EL MOTOR en nuestra newsletter.

Sigue toda la información de EL MOTOR desde Facebook, X o Instagram